La química Lu Wei puede recordar la primera vez que realmente vio los resultados de su investigación. Llegó el momento en que era estudiante de posgrado y, con sus compañeros de laboratorio, construyó un microscopio. “Cuando obtuvimos nuestra primera imagen, literalmente salté”, dice Wei. “Ver realmente es creer”.

Wei se ha inclinado hacia esa sensación de emoción desde entonces. Ahora, en su propio laboratorio en Caltech, utiliza nuevos métodos de espectroscopia y microscopia para profundizar en los tejidos biológicos y rastrear moléculas individuales en células vivas. Wei es solo uno de los muchos científicos e ingenieros del Instituto que trabajan arduamente para producir mejores imágenes de objetos tan pequeños como células individuales, tan mortales como tumores de cáncer de mama y tan lejanos como agujeros negros. En un intento por ver más profundo, más lejos y más rápido, estos investigadores amplían los límites de las técnicas tradicionales mediante el uso de nuevos enfoques, incluidos algunos que incorporan inteligencia artificial (IA), para identificar patrones más allá del alcance del ojo humano.

buenas vibraciones

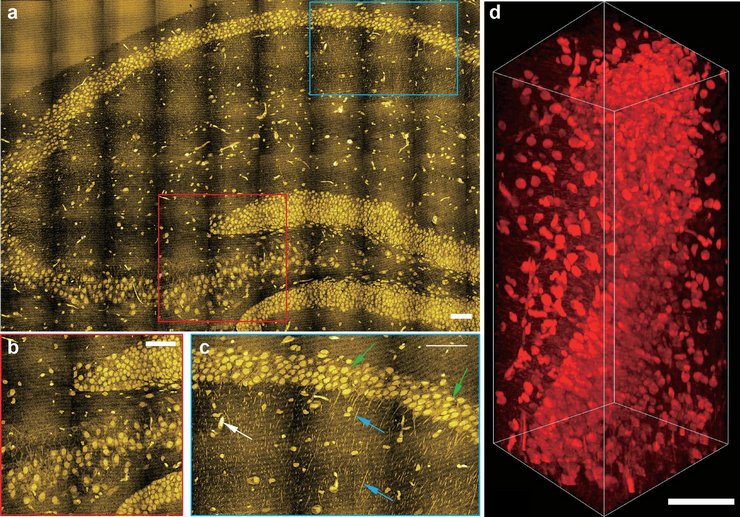

Para comprender verdaderamente las enfermedades y desarrollar mejores formas de tratarlas, es necesario saber qué sucede en el cuerpo a nivel celular. Wei tiene como objetivo hacer eso a través del diseño de técnicas de imagen innovadoras que explotan las vibraciones únicas de los enlaces químicos, que se estiran y doblan debido al movimiento constante de los átomos, para visualizar pequeñas biomoléculas con alta precisión y resolución utilizando las vibraciones detectadas como coordenadas. “Por ejemplo, las moléculas de agua están formadas por enlaces O y H que vibran a una frecuencia particular”, explica Wei. “Podemos detectar esa vibración y mapear dónde está el agua en nuestras células, tejidos y cuerpos”.

El equipo de Wei se ha basado en este conocimiento sobre cómo vibran los diferentes enlaces químicos y ha desarrollado etiquetas químicas no tóxicas que emiten vibraciones particulares. Estas etiquetas se pueden introducir en las moléculas para ayudar a los investigadores a rastrearlas en los entornos complejos de las células vivas. Gracias a un tipo especializado de microscopía desarrollado por Wei que puede captar las vibraciones sutiles, ha podido investigar los procesos metabólicos, o las reacciones químicas que sustentan la vida, dentro de diferentes tipos de células.

“Con el cáncer y otras enfermedades, estamos tratando de encontrar objetivos nuevos o adicionales asociados con el metabolismo que puedan ayudar a mejorar la eficiencia de los tratamientos”, dice Wei. “Anteriormente, usamos este enfoque para identificar un par de susceptibilidades metabólicas en las células de cáncer de melanoma a nivel de células madre. Lo que fue muy impresionante fue que pudimos identificar un proceso que se relacionaba directamente con un tipo muy agresivo de célula cancerosa”.

Ahora, utiliza las mismas tecnologías y procesos para explorar la regulación metabólica en enfermedades cardiovasculares y en el tejido cerebral. “Debido a que estamos en química, nos gusta comprender los aspectos fundamentales de cómo se controla exactamente algo”, dice Wei. Ese tipo de inmersión profunda en cómo se regulan los sistemas también podría usarse en los esfuerzos para hacer que las baterías de iones de litio sean más seguras. Siguiendo un proyecto que Wei inició en 2018, el equipo planea rastrear la dinámica química de las distribuciones de electrolitos en las baterías durante los ciclos de carga para descubrir cómo mantener las baterías más frías. Esto podría ayudar a abordar los problemas de seguridad actuales que incluyen incendios, que a menudo son causados por condiciones relacionadas con desequilibrios electrolíticos.

“Además de la biología, que sigue siendo mi principal interés, los instrumentos y técnicas que estamos desarrollando tienen aplicaciones potenciales para otros campos, como las energías renovables y la ciencia de los materiales, que planeo explorar más a fondo”, dice.

Ver con sonido

El ingeniero químico Mikhail Shapiro también quiere rastrear las funciones célula por célula en el cuerpo para desarrollar mejores diagnósticos y terapias de salud: una tarea nada fácil, dado que el cuerpo humano contiene unos 37 billones de células. Pero él usa un tipo diferente de vibración, ondas de sonido, en lugar de vibraciones causadas por el movimiento, para obtener imágenes de las actividades en lo profundo del hábitat natural de una célula.

Para hacer esto, Shapiro ha sido pionera en una técnica que utiliza la ingeniería genética para crear genes denominados “reporteros acústicos” que producen proteínas llenas de aire llamadas vesículas de gas cuando se insertan en una célula. Estas vesículas, o “proteínas acústicas”, contienen bolsas de aire que pueden reflejar ondas sonoras, lo que permite localizarlas y rastrearlas mediante una de las técnicas de imagen más utilizadas en el mundo: la ecografía.

“El desafío ha sido que, históricamente, el ultrasonido nos ha mostrado la anatomía, como dónde están los huesos y los músculos, pero no podía mostrarnos células específicas”, dice Shapiro. “Ahora, no solo podemos ver dónde están ubicadas las células, sino

también podemos ver su función porque podemos programarlos para que solo hagan las vesículas de gas bajo ciertas condiciones. Esto ha abierto un nuevo potencial para la obtención de imágenes celulares de tejidos profundos que antes no era posible”. Shapiro y su equipo también pueden amplificar las ondas de ultrasonido a una fuerza que puede reventar las vesículas de gas en lugar de simplemente hacerlas sonar; esto da como resultado una señal más fuerte que permite a los investigadores ver cantidades mucho más pequeñas de vesículas. Esta mayor sensibilidad tiene el potencial de mejorar los estudios del microbioma intestinal, donde vive una gran parte de las células inmunitarias, al poder concentrarse en unas pocas células en un mar de muchas. “Una de nuestras ambiciones a corto plazo es visualizar las células inmunitarias a medida que recorren el cuerpo y buscan y atacan patógenos o tumores”, dice Shapiro. “Queremos ver cómo se desarrolla este drama en tiempo real”.

Como alguien que estudió neurociencia como estudiante universitario, Shapiro también está muy interesado en aprender sobre el cerebro. De hecho, la falta de tecnologías no invasivas efectivas con las que estudiar las neuronas es lo que llevó a Shapiro a obtener un doctorado en ingeniería biológica. El año pasado, recibió subvenciones para dos estudios de neurociencia de la iniciativa Brain Research Through Advancing Innovative Neurotechnologies (BRAIN) de los Institutos Nacionales de la Salud. Uno de estos proyectos financiados por BRAIN tiene como objetivo obtener imágenes de la actividad neuronal mediante ultrasonidos a escala cerebral como un medio para ayudar a comprender y desarrollar mejores tratamientos para las enfermedades neurológicas. El otro estudio se centra en las interfaces cerebro-computadora e implica el uso de ultrasonido para registrar señales cerebrales de una manera menos invasiva que los implantes actuales. La información obtenida de este estudio podría, por ejemplo, utilizarse para ayudar a los pacientes paralizados a aprender a realizar diversas tareas con neuroprótesis.

En última instancia, Shapiro espera que las tecnologías que desarrolle se conviertan en un modelo para varios tipos de investigación, con laboratorios de biología en todo el mundo colocando máquinas de ultrasonido junto a sus microscopios ópticos. “Además, estaré feliz si los médicos comienzan a usar el ultrasonido para ver dónde van sus terapias celulares y génicas dentro del cuerpo y qué están haciendo, para que puedan tomar medidas correctivas si la terapia no está haciendo lo que quieren”. él dice. “Espero que nuestras proteínas acústicas hagan posible que muchos más laboratorios puedan ver cosas que antes eran invisibles dentro de los seres vivos”.

Enfoque láser

En 2014, el ingeniero de Caltech, Lihong Wang, anunció que había tenido éxito en su búsqueda para construir la cámara más rápida del mundo, la primera capaz de capturar un pulso de luz, o rayo láser, mientras se mueve. Desde entonces, ha mejorado su tecnología y ha construido cámaras que pueden ver la dispersión de la luz en cámara lenta, observar objetos aparentemente transparentes y producir videos en 3D. “Tenemos que entender la luz antes de entender completamente el mundo y entender completamente la naturaleza”, dice Wang. “La luz tiene el límite máximo de velocidad si Einstein todavía tiene razón. Con nuestra cámara, por primera vez, podemos ver un pulso de luz a la velocidad de la luz”.

El año pasado, en la edición del 13 de enero de Science Advances, Wang informó sobre el progreso en el estudio de sistemas caóticos de su equipo con su cámara de fotografía ultrarrápida comprimida (CUP), capaz de alcanzar velocidades de hasta 70 billones de fotogramas por segundo. Los sistemas caóticos, como la turbulencia del aire y ciertas condiciones climáticas, se destacan por exhibir un comportamiento predecible al principio, pero que se vuelve cada vez más aleatorio con el tiempo. Su experimento observó que la luz láser, que se mueve a velocidades extremadamente altas, se dispersa en una cámara diseñada para inducir reflejos caóticos. Descubrir cómo se mueve la luz en condiciones caóticas tiene aplicaciones en física, comunicaciones, criptografía y navegación aérea.

“Se puede argumentar que estamos extendiendo lo que nuestros ojos pueden ver mucho más allá de la piel. Estamos mostrando a los cirujanos lo que verían después de abrir un cuerpo sin tener que hacerlo”.

— LIHONG WANG

Además, con algunas modificaciones, Wang utilizó su cámara ultrarrápida para capturar señales que viajan a través de las células nerviosas por primera vez, una hazaña que se informó en la edición del 6 de septiembre de Nature Communications.

Al igual que Shapiro, Wang también crea técnicas de imágenes médicas que utilizan ultrasonido pero funcionan en combinación con láseres. Ha inventado una serie de técnicas de imagen fotoacústica que combinan ondas de luz y sonido para obtener vistas profundas y no invasivas del tejido biológico sin riesgo de radiación. Por ejemplo, su escáner láser-sónico para detectar tumores de cáncer de mama se está desarrollando actualmente para su uso en centros de atención médica. Puede identificar tumores en 15 segundos sin la incomodidad o la radiación de las mamografías, el estándar de oro actual en la detección del cáncer de mama.

“Usamos una dosis segura de luz láser con el color correcto que en realidad puede penetrar bastante profundamente en el tejido biológico, pero la luz no irá directamente, como lo hacen los rayos X; simplemente deambulará”, explica Wang. “Por eso recurrimos a la fotoacústica. Cuando moléculas como la hemoglobina de la sangre

absorben la luz, comenzarán a vibrar, y esa vibración es una fuente de sonido. Capturamos esa señal de sonido y luego podemos identificar de dónde proviene esa señal y formar una imagen”.

Compara el proceso con el funcionamiento de los relámpagos y los truenos: el relámpago es el pulso del láser y el trueno es el sonido que esperas escuchar unos segundos después. De la misma manera que se puede triangular la ubicación de una tormenta utilizando el tiempo entre estos fenómenos meteorológicos, Wang y sus colaboradores pueden construir una imagen del interior del cuerpo.

“Se puede argumentar que estamos extendiendo lo que nuestro ojo puede ver mucho más allá de la piel”, dice Wang, quien recientemente usó sus técnicas de imágenes fotoacústicas para mirar dentro del cerebro y detectar cambios mínimos en la concentración y oxigenación de la sangre. “Estamos mostrando a los cirujanos lo que verían después de abrir un cuerpo sin tener que hacerlo”.

Nuevos ángulos

Mientras Wang trabaja para ver a través de los objetos, Changhuei Yang también intenta ver a su alrededor. En mayo de 2022, él y los miembros de su laboratorio informaron en Nature Photonics sobre una técnica que puede detectar un objeto de interés fuera de la línea de visión del espectador. El método de imagen funciona mediante el uso de la formación de frente de onda, en el que la luz se acumula en una pared para generar un punto de luz enfocado para escanear el objeto, lo que permite a los investigadores ver lo que está fuera de la vista.

“Esta tecnología podría tener uso en el futuro para los automóviles autónomos, así como para las naves espaciales que atraviesan un planeta donde podría haber, por ejemplo, cavernas ocultas que quieran explorar”, dice Yang. “Algo como esto nos permitiría hacer imágenes sin línea de visión e interrogar un entorno de una manera única”.

Pero mirar alrededor de las esquinas no es la única forma de encontrar objetos y patrones ocultos. La mayor parte del trabajo de Yang involucra el desarrollo de mejores microscopios, mediante el uso de sensores y métodos computacionales, para ver más profundamente en los tejidos biológicos que nunca antes y extraer información de esas muestras. También ha comenzado a utilizar el aprendizaje profundo, un tipo de IA, para detectar patrones en imágenes biológicas que un observador humano no podría detectar.

“Hay cosas que probablemente predicen enfermedades que los ojos humanos simplemente no pueden detectar porque nuestra capacidad para reconocer patrones es limitada”, dice Yang.

En esencia, Yang quiere hacer máquinas a las que se les pueda enseñar a ver mejor que nosotros, y ha logrado un progreso significativo. En colaboración con Magdalena Zernicka-Goetz, profesora de Biología e Ingeniería Biológica de Bren, Yang ha desarrollado una forma de usar algoritmos de aprendizaje automático para detectar sutiles diferencias de patrones en imágenes de embriones durante el proceso de fertilización in vitro (FIV) que podrían indicar si están saludable y resultará en un embarazo exitoso o no.

Junto con patólogos de la Universidad de Washington en St. Louis, Yang y su equipo trataron recientemente de verificar una hipótesis que muchos oncólogos creían que era cierta: que si las células cancerosas están bien encapsuladas por los tejidos conectivos, no se propagarán a otras partes del cuerpo. En cambio, un análisis de aprendizaje automático de imágenes de muestras de tumores para los que se conocía el resultado indicó lo contrario: cuando la encapsulación tiene fugas, el riesgo de metástasis parece ser menor. Una posible explicación de por qué esto puede ser cierto es que los glóbulos blancos pueden ingresar y mantener las células cancerosas bajo control.

“Toda esta área de construcción de instrumentos y algoritmos es muy rica en términos de oportunidades para generar nuevas innovaciones”, dice Yang, quien recientemente lanzó un nuevo proyecto destinado a hacer una cámara para obtener imágenes de las interacciones entre las raíces y el suelo bajo tierra para obtener más información. sobre los efectos del cambio climático en los cultivos y la vegetación. “Y poder tener un impacto significativo es realmente gratificante. Saber que, algún día, lo que estamos haciendo tal vez tendrá un impacto profundo en la patología, por ejemplo, o en los procedimientos de FIV, es algo que creo que no solo me impulsa a mí, sino también al resto de mi grupo”.

Cámaras que calculan

La científica informática Katie Bouman también usa IA para ayudar a compilar imágenes que de otro modo sería imposible crear. Pero mientras que Yang y sus colegas se enfocan, tanto literal como figurativamente, en células y moléculas microscópicas, Bouman normalmente fija su mirada en objetos mucho más grandes, como agujeros negros, y construye instrumentos que reinventan el papel y la función de las propias cámaras para hacer eso.

“Me gusta decir que el tamaño es equivalente al tamaño de un grano de arena, si ese grano de arena está en Nueva York y lo estoy viendo desde Los Ángeles”.

— KATIE BOUMAN

“Durante cientos de años, las cámaras se han modelado a partir de cómo funcionan nuestros ojos, pero eso solo puede llevarte hasta cierto punto”, dice Bouman. “Estamos explorando qué sucede si te permites romper el modelo estándar de cómo debería verse una cámara. Al resolver las cámaras computacionales novedosas que combinan nuevos tipos de hardware con software, la esperanza es que la sinergia entre ellos le permita recuperar imágenes o ver fenómenos que no es posible ver.

cantar enfoques tradicionales.”

Bouman se interesó por primera vez en las cámaras computacionales como estudiante de posgrado en el MIT, donde trabajó en el proyecto Event Horizon Telescope (EHT) como miembro del equipo que produjo la primera imagen de un agujero negro en 2019. Desde que se unió a Caltech ese mismo año , continuó este trabajo y dirigió un equipo de Caltech de colaboradores clave para el logro más reciente de la Colaboración EHT: generar la primera imagen del agujero negro supermasivo en el centro de la galaxia de la Vía Láctea. “El gran desafío de obtener imágenes de cualquier agujero negro es que están tan lejos y son tan compactos que son muy, muy pequeños en el cielo”, dice Bouman. “Me gusta decir que el tamaño es equivalente al tamaño de un grano de arena, si ese grano de arena está en Nueva York y lo estoy viendo desde Los Ángeles”.

Para tomar una fotografía real de algo tan minúsculo, dice, se necesitaría un telescopio del tamaño de la Tierra. En cambio, el equipo tomó imágenes de telescopios de todo el mundo para formar una sola imagen con la ayuda de algoritmos para unir los puntos en blanco. “Si solo recolectamos luz en muy pocos puntos alrededor del mundo, tenemos que completar la información que falta”, explica Bouman. “Y debemos llenarlo inteligentemente. Mi objetivo principal era tomar los datos que recopilamos y recuperar la imagen subyacente. No es como una cámara normal donde recoges toda la información y la puedes ver con tus ojos.

Tienes que asegurarte de haber capturado la variedad de imágenes posibles que podrían explicar los datos”.

Existe una versión simple de este tipo de cámara computacional compleja en los teléfonos inteligentes. Cuando toma una fotografía usando la función de alto rango dinámico (HDR), en realidad produce numerosas fotos tomadas a diferentes velocidades de obturación. Luego, la cámara emplea un algoritmo para extraer datos de cada una de esas imágenes para crear una composición de las mejores partes. Del mismo modo, las cámaras que diseñan Bouman y su grupo de investigación combinan sensores e IA para lograr imágenes, en muchas escalas diferentes, de objetos y fenómenos nunca antes vistos.

Como la mayoría de las tecnologías de imágenes, las cámaras computacionales también tienen aplicaciones médicas. Con el experto en aprendizaje automático Yisong Yue, profesor de informática y ciencias matemáticas y codirector de la iniciativa AI4Science de Caltech, Bouman ha trabajado para acelerar y mejorar las máquinas de resonancia magnética mediante el desarrollo de algoritmos que ayudan a la máquina a ajustar las imágenes que toma en tiempo real. . (Actualmente, las resonancias magnéticas deben basarse en ubicaciones de muestra predeterminadas). “Nuestro enfoque permite que se tomen decisiones mientras se escanea al paciente para tratar de obtener las mediciones más informativas en el menor tiempo posible”, dice Bouman. (Tianwei Yin, Zihui Wu, He Sun, Adrian V. Dalca y Yisong Yue colaboraron en este trabajo).

Si bien espera continuar su búsqueda para mejorar las imágenes astronómicas, Bouman dice que está interesada en aplicar sus cámaras computacionales a campos más allá de los que ya ha explorado, como la sismología y la robótica. “El tamaño pequeño de Caltech me permite colaborar mucho más fácilmente entre disciplinas”, dice ella. “Hay tantas aplicaciones potenciales en el campus; el desafío ahora es cómo elegir entre ellos, porque no se puede hacer todo”.

0 comments

0 comments